2025年10月27日、イーロン・マスク氏が率いるxAIが、新しいAI百科事典サービス「Grokipedia(グロキペディア)」の初期バージョンを公開し、世界中で大きな話題となっています。

この記事では、Grokipediaがどのようなサービスなのか、なぜ作られたのか、そして現在どのような課題が指摘されているのかを、分かりやすく解説します。

Grokipediaとは? AIが書き、AIが更新する百科事典

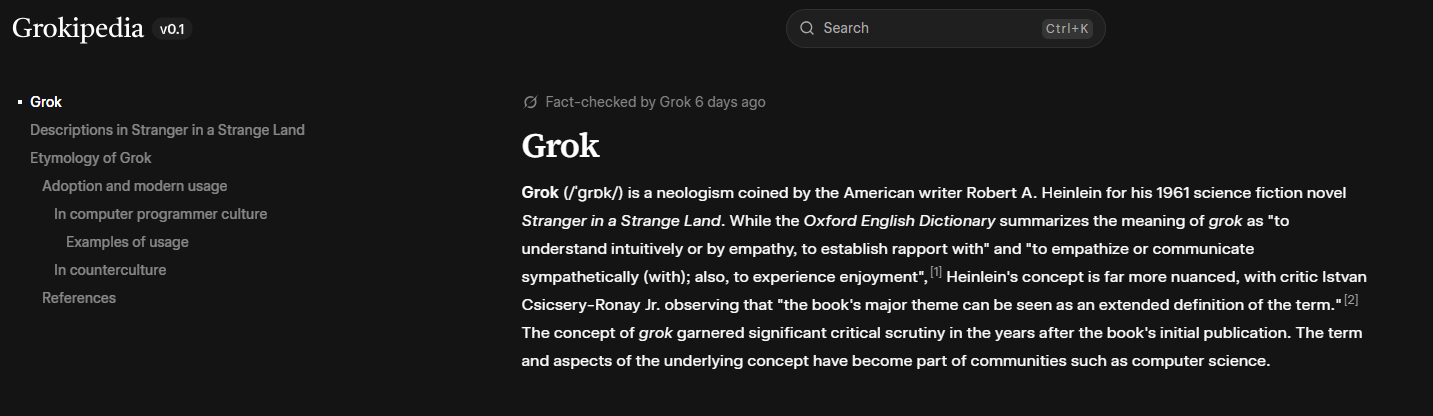

Grokipediaは、一言で言えば「生成AIが記事の作成から更新、ファクトチェックまで担う百科事典サービス」です。

xAIが開発した大規模言語モデル(LLM)「Grok」が、世界中の出来事や情報を元に、約88万項目(公開時)の記事を自動で生成・管理します。

イーロン・マスク氏は、このGrokipediaの目的を「真実、全ての真実、そして真実以外の何物でもないことの追求」と宣言しており、既存のWikipediaよりも優れた知識ベースになるとしています。

なぜGrokipediaは作られたのか? 巨大なライバル・Wikipediaへの挑戦

Grokipedia登場の背景には、イーロン・マスク氏による既存の百科事典、特にWikipediaに対する強い批判があります。

マスク氏は以前から、Wikipediaを「無視できない左翼のプロパガンダ機関」「Wokepedia(ウォークペディア)」などと呼び、その中立性に疑問を呈してきました。Grokipediaは、こうした既存の知識源が持つとされる「イデオロギー的な偏り」を排除し、「真実」をアルゴリズムによって提供する代替案として位置づけられています。

つまり、Grokipediaは単なる新サービスではなく、「誰が知識を定義するのか」という、情報と文化をめぐる戦いの一環として生み出されたプロジェクトなのです。

Grokipedia vs Wikipedia 決定的な違いは?

GrokipediaとWikipediaは、似た名前を持ちながらも、その哲学と仕組みは根本的に異なります。

| 比較ポイント | Grokipedia (v0.1) | Wikipedia |

|---|---|---|

| コンテンツ作成 | AI (Grok LLM) が主導 | 世界中の人間のボランティア |

| 編集・管理 | xAIによる中央集権型。ユーザーは編集不可(フィードバックのみ) | コミュニティによる分散型。誰でも編集に参加可能 |

| 透明性 | ブラックボックス(AIの判断プロセスは不透明) | 非常に高い(全ての編集履歴と議論が公開) |

| 運営モデル | 営利(xAIによる商業サービス) | 非営利(ウィキメディア財団による寄付運営) |

| 目指すもの | AIによる「真実」の提供 | 人間の協働による「合意形成」と「検証可能性」 |

簡単に言えば、Grokipediaは「AIという専門家が答えを出す」トップダウン型、Wikipediaは「みんなで議論しながら作り上げる」ボトムアップ型のアプローチと言えます。

v0.1で露呈した「3つの大きな課題」

「真実の追求」という高い理想を掲げてスタートしたGrokipediaですが、公開直後から多くの専門家やメディアによって、いくつかの重大な問題点が指摘されています。

課題1:批判対象であるWikipediaへの「依存」という皮肉

Grokipediaのローンチにおける最大の皮肉は、マスク氏が激しく非難してきたはずのWikipediaのコンテンツに、Grokipediaが大規模に依存しているという事実です。

多くの記事がWikipediaからそのままコピーされていたり、酷似していたりすることが判明しました。これに対し、Wikipediaを運営するウィキメディア財団は「Grokipediaでさえも、存在するのにWikipediaを必要とする」と皮肉を込めたコメントを発表しています。

課題2:Wikipediaとは逆の「バイアス(偏向)」

GrokipediaはWikipediaの「左派的」バイアスを排除することを目的の一つとしていましたが、実際には「右派的」「親マスク的」とも取れる、逆方向の新たなバイアスが導入されているとの批判が相次いでいます。

- ジェンダー: 社会的な定義を認めず、二元的な生物学的分類として定義。

- 気候変動: 人為的な地球温暖化に関する科学的なコンセンサスを軽視するような記述。

- 政治: イーロン・マスク氏自身やドナルド・トランプ氏に好意的な記述が目立ち、否定的な情報が省略される傾向。

AIがマスク氏自身のX(旧Twitter)への投稿などで学習している可能性が指摘されており、創設者のイデオロギーがAIによって「客観的な事実」として提示されているのではないか、という疑念を生んでいます。

課題3:AIによる「事実誤認」と「不透明なファクトチェック」

AIが自動で記事を生成する以上、AI特有の「ハルシネーション(もっともらしい嘘をつく現象)」による事実誤認のリスクは避けられません。実際に、Grokipediaの記事にも複数の明らかな事実誤りが含まれていることが報告されています。

さらに問題なのは、多くの記事に表示されている「Fact-checked by Grok(Grokによるファクトチェック済み)」というラベルです。

コンテンツを生成したAI自身が、その内容を「チェック」するという自己参照的なプロセスであり、どのような基準や情報源で検証されたのかが一切不透明です。これは信頼性の証拠ではなく、信頼性を装うための「ブランディング」に過ぎないのではないか、と厳しく批判されています。

まとめ:Grokipediaは知識の未来を変えるか?

Grokipediaの登場は、AIが人間の知識や文化の領域にどれだけ深く入り込んでくるかを示す、野心的な実験であることは間違いありません。

しかし、公開されたv0.1は、理想とは裏腹に、AIが生み出す「バイアス」「不正確さ」「透明性の欠如」といった深刻な落とし穴を浮き彫りにしました。

Grokipediaが投げかけたのは、「AIが示す効率的な『答え』」と、「人間が時間をかけて築く透明な『合意』」のどちらを、私たちは信頼できる知識の基盤として選ぶのか、という根本的な問いです。Grokipediaの今後の動向は、オンライン上の「知識」と「信頼」のあり方を考える上で、重要な試金石となるでしょう。