生成AIの世界に新たなスターが誕生しました。その名も「NextStep-1」。

「AIで絵を描く」といえば、これまでは「拡散モデル(Diffusion Model)」という技術が主流でした。しかし、NextStep-1は「自己回帰モデル(Autoregressive Model)」という、文章を生成するAIと同じ仕組みを使いながら、拡散モデルに匹敵する、あるいはそれ以上の品質の画像を作り出すことに成功し、世界中の開発者を驚かせました。

この記事では、

- なぜNextStep-1が画期的なのか?

- これまでのAI画像生成と何が違うのか?

- NextStep-1はどんなことができるのか?

といった点を、専門的な知識がない方にも分かりやすく解説していきます。最新のAIトレンドに乗り遅れたくない方は、ぜひ最後までご覧ください。

これまでのAI画像生成の「常識」と「課題」

NextStep-1の凄さを理解するために、まずはこれまでのAI画像生成技術について簡単におさらいしましょう。主流だったのは主に2つのアプローチです。

- 拡散モデル(Diffusion Models)

- 強み: ノイズだらけの画像から少しずつノイズを取り除いていく手法で、非常に高品質でリアルな画像を生成できるのが最大の特徴です。MidjourneyやStable Diffusionなどがこの技術をベースにしています。

- 弱み: 高品質な分、計算に時間がかかり、生成スピードが遅くなりがちです。

- (従来の)自己回帰モデル(Autoregressive Models)

- 強み: 単語を一つずつ繋げて文章を作るように、画像のパーツを順番に描いていく手法です。仕組みがシンプルで、スケーラブル(大規模化しやすい)という利点があります。

- 弱み: 画像を「視覚的な単語」に無理やり変換(ベクトル量子化)する過程で、細かいディテールが失われがちでした。そのため、「品質は拡散モデルに劣る」というのが長年の常識でした。

つまり、開発者たちは「生成スピードか、品質か」という二者択一を迫られていたのです。

NextStep-1は常識を覆した!その仕組みとは?

NextStep-1は、この「スピード vs 品質」のジレンマを、画期的なアイデアで解決しました。

秘密は「思考家」と「画家」のコンビネーション

NextStep-1の内部は、大きく分けて2つの役割を持つAIで構成されています。

- 思考家(Thinker) - 巨大な頭脳

- 140億パラメータという巨大なAI(言語モデルがベース)です。

- ユーザーが入力したテキスト(プロンプト)の意味を深く理解し、「次に何を描くべきか」という全体構成やコンセプトを考えます。まさに司令塔の役割です。

- 画家(Painter) - 優秀なアーティスト

- 思考家と比べるとずっと軽量なAIです。

- 思考家からの指示を受け取り、それを忠実に、そして高速に画像のパーツとして描画します。

この「考える部分」と「描く部分」を分業させるアーキテクチャが、NextStep-1の強さの秘密です。特に重要なのは、生成AIにとって本当に難しいのは「描く」ことよりも「何をどう構成するかを考える」ことだと証明した点です。計算リソースのほとんど(約99%)を「思考家」に集中させることで、効率的に高品質な画像生成を実現しました。

「視覚的な単語」の壁を突破

さらに、従来の自己回帰モデルが抱えていた「画像のディテールが失われる」という問題も、画像を無理に離散的な単語に変換せず、連続的なデータのまま扱うという新しいアプローチで解決。これにより、拡散モデルのような滑らかでリッチな表現が可能になったのです。

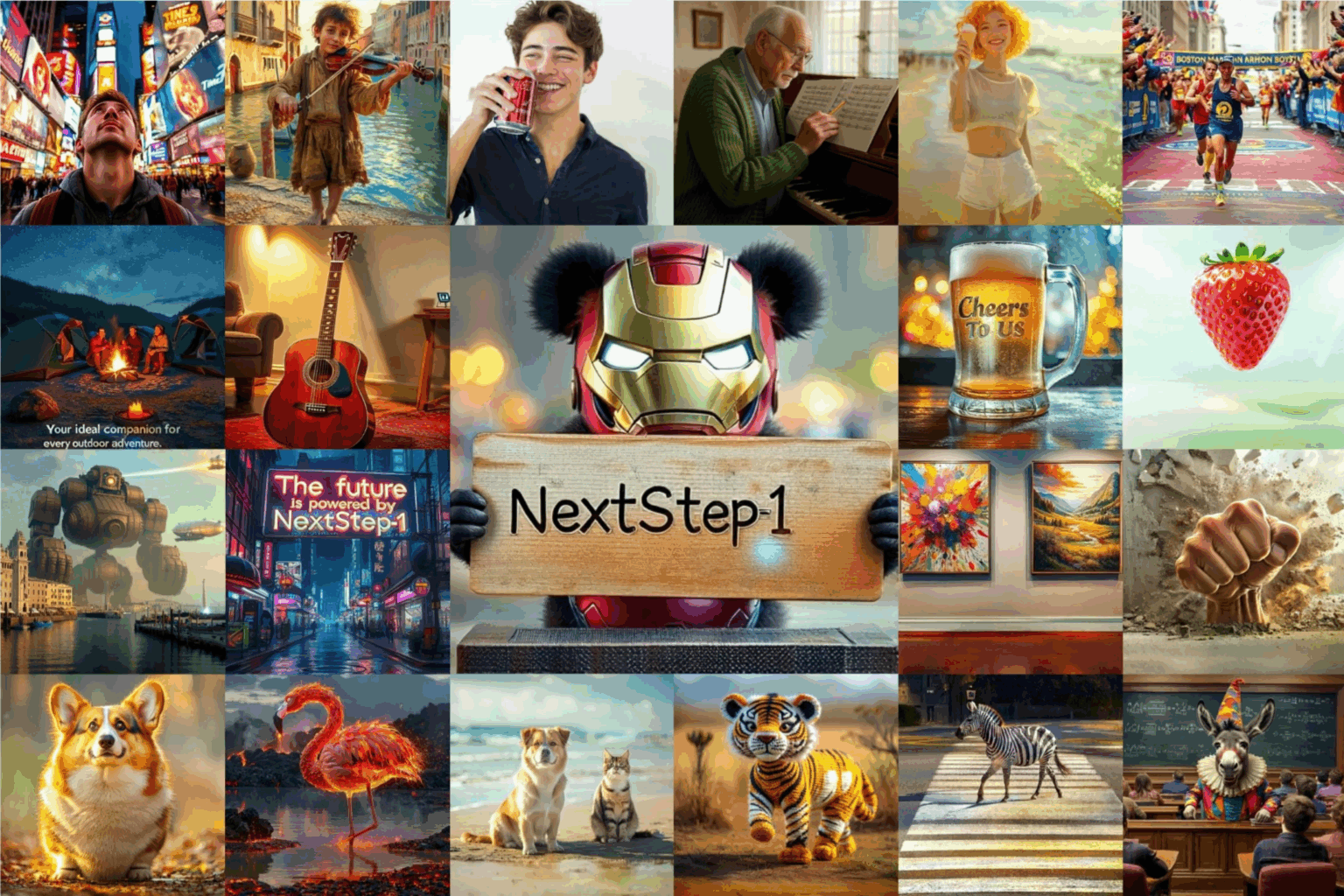

NextStep-1で何ができる?驚きの性能

NextStep-1は、単に綺麗な絵が描けるだけではありません。その真価は、テキストの理解力と編集能力にあります。

1. テキストからの画像生成

複雑で細かい指示が含まれるプロンプトでも、その内容を正確に理解して画像に反映させる能力に長けています。

例:"NextStep-1.1 is coming"と書かれた壁のリアルな写真

このようなプロンプトで、画像内に正確なテキストを描画することができます。これは多くの画像生成AIが苦手とするタスクです。

2. 指示に基づいた画像編集

NextStep-1のもう一つの強力な機能が、画像編集です。元の画像と「こう変えてほしい」という指示テキストを入力するだけで、驚くほど自然な編集を行ってくれます。

例:<犬の写真> + 犬に海賊の帽子をかぶせて。背景を嵐の海に変えて。

このように、「オブジェクトの追加」「背景の変更」といった複数の編集指示を一度に実行できる、非常に高度な能力を持っています。

NextStep-1の課題と未来

もちろん、NextStep-1も完璧ではありません。

- 生成スピード: 順番に描画していく性質上、最速のモデルと比べるとまだ改善の余地があります。

- キャラクターの一貫性: 同じキャラクターで少しだけ表情を変える、といった細かい編集で、顔つきが変わってしまうことがある、という指摘もあります。

しかし、開発元であるStepFun AIは、これらを「解決可能な技術的課題」と捉えており、モデルは今後さらに進化していくと予想されます。何より、この画期的なモデルがオープンソースとして公開されている点は非常に重要です。世界中の開発者がNextStep-1を改良し、新たな応用を生み出していくことで、AIによるクリエイティブの可能性はさらに広がっていくでしょう。

まとめ:AIの未来は「書く」と「描く」が融合する

NextStep-1の登場は、単なる高性能な画像生成AIが生まれた、という話に留まりません。

文章を生成するのと同じ「次のトークンを予測する」というシンプルな原理で、高品質な画像の生成も編集も可能になったという事実が、AIの未来を指し示しています。

AIにとって、「言葉を紡ぐこと」と「絵を描くこと」の境界線が溶け始めているのです。NextStep-1は、そんな未来への大きな一歩(Next Step)と言えるでしょう。今後の進化から目が離せません。