生成AIの爆発的な普及により、世界の演算リソースは枯渇し、特定のハードウェアベンダーへの過度な依存がリスクとなる時代を迎えました。その中で、SNSの巨人 Meta Platforms(以下、Meta) が打ち出したのは、他社の追随を許さない圧倒的なスピードの「ハードウェア自社化」です。

Metaは、独自開発のAI処理アクセラレータ 「Meta Training and Inference Accelerator(MTIA)」 のロードマップを一挙に更新しました。驚くべきは、 「MTIA 300」 から最上位の 「MTIA 500」 まで、全4世代のチップをわずか24ヶ月以内に稼働させるという強行軍です。

本稿では、Metaがなぜこれほどまでに急ぐのか、そして「MTIA」がもたらす技術的ブレイクスルーがAI業界にどのような変化を及ぼすのかを詳説します。

1. 汎用GPUから「専用シリコン」へ:Metaが選んだ第3の道

これまで多くの企業は、NVIDIAのGPUを「万能な計算資源」として活用してきました。しかし、Metaのような巨大プラットフォームにとって、汎用性は時に非効率を生みます。

推論コストの劇的な最適化

MetaのサービスにおけるAI活用の核心は、学習よりもむしろ日常的な 「推論」 にあります。

- 数十億件の広告やコンテンツのランキング。

- 生成AI(Llamaシリーズ)によるユーザー対話。

これらの定型化された膨大な処理に対し、学習用の機能を多く含む高価な汎用GPUを使うのは経済的ではありません。Metaは、推論に必要な機能だけに絞り込んだ 「ASIC(特定用途向け集積回路)」 を自社設計することで、計算効率を極限まで高める道を選びました。

供給リスクのヘッジと独自性

「NVIDIA待ち」による開発遅延は、テック企業にとって致命傷となります。独自のシリコンロードマップを持つことで、供給網の安定化を図ると同時に、自社のアルゴリズムに最適化した専用命令セットを組み込むことが可能になります。

2. 24ヶ月で4世代を駆け抜ける:MTIAロードマップの衝撃

Metaが提示した4つのモデルは、それぞれがAIインフラの進化における重要なマイルストーンを担っています。

| モデル名称 | コア機能 | 演算性能 (FP8) | メモリ帯域 (HBM) | 登場時期 |

| MTIA 300 | 推薦アルゴリズム最適化 | 1.2 PFLOPs | 6.12 TB/s | 稼働済 |

| MTIA 400 | 生成AI・推薦のハイブリッド | 6.0 PFLOPs | 9.2 TB/s | 展開中 |

| MTIA 450 | 次世代LLM推論の標準機 | 7.0 PFLOPs | 18.4 TB/s | 2027年Q1予定 |

| MTIA 500 | ハイエンド推論の到達点 | 10.0 PFLOPs | 27.6 TB/s | 2027年内予定 |

MTIA 500:メモリ帯域27.6 TB/sという怪物

特筆すべきは、2027年に稼働予定の最上位モデル MTIA 500 です。AIモデルの巨大化に伴い、最大のボトルネックとなっているのがデータの転送速度(メモリ帯域)です。MTIA 500がターゲットとする 27.6 TB/s という数値は、現在の市場にある最高峰のハードウェアを遥かに凌駕し、将来の 「Llama 5」 クラスの超巨大モデルを遅延なしで動かすための生命線となります。

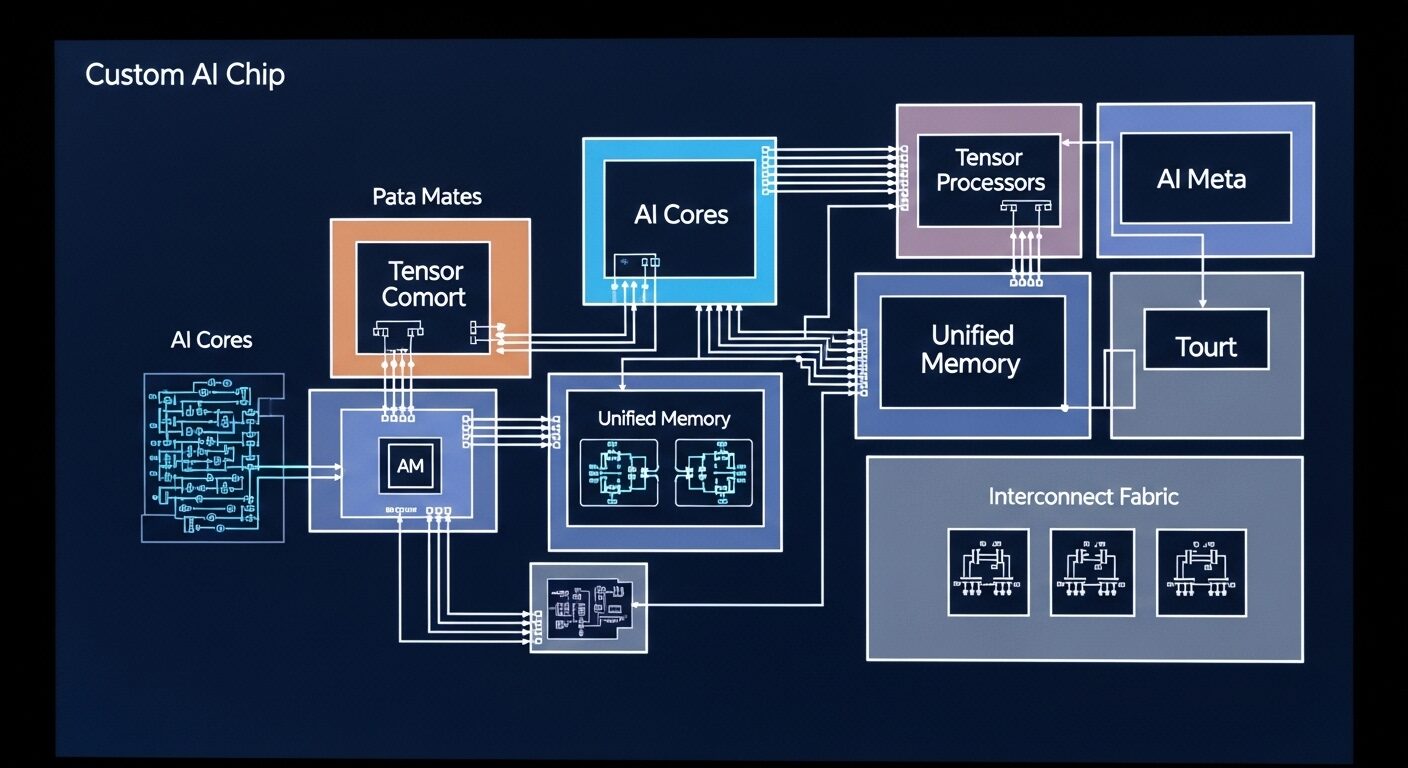

3. アジャイルな半導体開発:チップレット技術の採用

なぜMetaは半導体メーカーですら困難な「半年スパン」でのモデル更新が可能なのか。その秘密は 「チップレット・アーキテクチャ」 にあります。

従来の半導体は一つの巨大なシリコン(モノリス)で作られていましたが、Metaは機能を小分けにした「チップレット」を組み合わせる手法を採用しました。

- 迅速な更新: メモリコントローラーだけ、あるいは演算ユニットだけを最新版に差し替えることで、全体の設計期間を大幅に短縮。

- 歩留まりの向上: 小さなチップを組み合わせるため製造上の欠陥が出にくく、コストパフォーマンスが向上。

このアジャイルな開発体制こそが、変化の激しいAIトレンドにハードウェアを追従させる唯一の解といえます。

4. エコシステムの統合:PyTorchとMXフォーマット

Metaの強みはハードウェア単体ではなく、世界標準のAIフレームワーク 「PyTorch」 を自ら抱えている点にあります。

MTIAは、PyTorchのコードを直接かつ最適に実行できるよう設計されています。さらに、データ量を圧縮して高速化する 「MX4(4ビットマイクロスケーリング)」 フォーマットを全面的にサポート。これにより、モデルの精度を犠牲にすることなく、消費電力を抑えつつスループットを数倍に引き上げることが可能になります。

5. 市場破壊の予兆:Metaの「垂直統合」が意味するもの

MetaのMTIA戦略は、GoogleのTPUやAmazonのTrainium/Inferentiaと比較しても、より「自社サービスへの特化」が鮮明です。Metaはクラウド業者ではないため、チップを他社に貸し出す必要がありません。

この「自社専用」という割り切りが、NVIDIAのGPUでは実現不可能な、Metaのワークロードに100%合致した究極の効率を生み出します。 「Llama 4」 がリリースされる頃には、Metaのインフラは他社とは比較にならないほど低コストで高品質なAI体験をユーザーに提供できるようになっているでしょう。

まとめ:ハードウェアを支配する者が、AIの未来を制す

MetaによるMTIA 300から500の一挙公開は、単なるスペック競争ではありません。それは、AIの覇権が「ソフトウェアのアルゴリズム」だけでなく、それを支える「物理的な計算機」の支配に移行したことを物語っています。

2027年までに全4世代が揃ったとき、Metaはもはやプラットフォーマーの枠を超え、世界で最も洗練されたAI演算システムを保有するハードウェア企業としても君臨することになるでしょう。私たちが日々目にするリール動画の裏側で、この静かなる「シリコン革命」が、AIの未来を確実に書き換えようとしています。

本記事は、Metaの技術ホワイトペーパーおよびロードマップに基づき、市場への影響を分析したものです。